DeepSeek API打出“底价牌” 输入价低至2分钱,海外对手贵上千倍

2026[[ $t('article.detail.demo_date') ]] · 0 [[ $t('article.detail.read') ]]

4月26日起,DeepSeek全系列API服务价格大幅下调:输入缓存命中价格降至原有价格的十分之一,同时Pro模型在5月5日前叠加2.5折限时优惠。两重折扣叠加后,DeepSeek-V4-Pro输入(缓存命中)低至0.025元/百万Tokens,V4-Flash更是降至0.02元/百万Tokens。

这相当于:1元人民币可以购买至少4000万Tokens的输入处理能力。对开发者而言,一次中等规模的AI应用调用,成本几乎可以忽略不计。

价差超千倍:用“分”对抗“美元”

作为参照,OpenRouter平台数据显示,海外最新大模型GPT-5.5 Pro的加权平均输入价格为30美元/百万Tokens(约207元人民币),输出价格180美元/百万Tokens(约1242元人民币)。

以输出价计算:生成100万Tokens,DeepSeek-V4-Pro收费约6元(非缓存输出价),而GPT-5.5 Pro收费约1242元——相差207倍。如果享受缓存命中,输入端的价差更是高达8000倍以上。

大规模调用时,差距更为悬殊。假设一个企业每月需要处理1亿Tokens的输出:

· DeepSeek-V4-Pro:约600元

· GPT-5.5 Pro:约12.4万元

两者相差超过200倍。如果调用量达到10亿Tokens,海外模型的月费将超过120万元,而DeepSeek仅需约6000元。

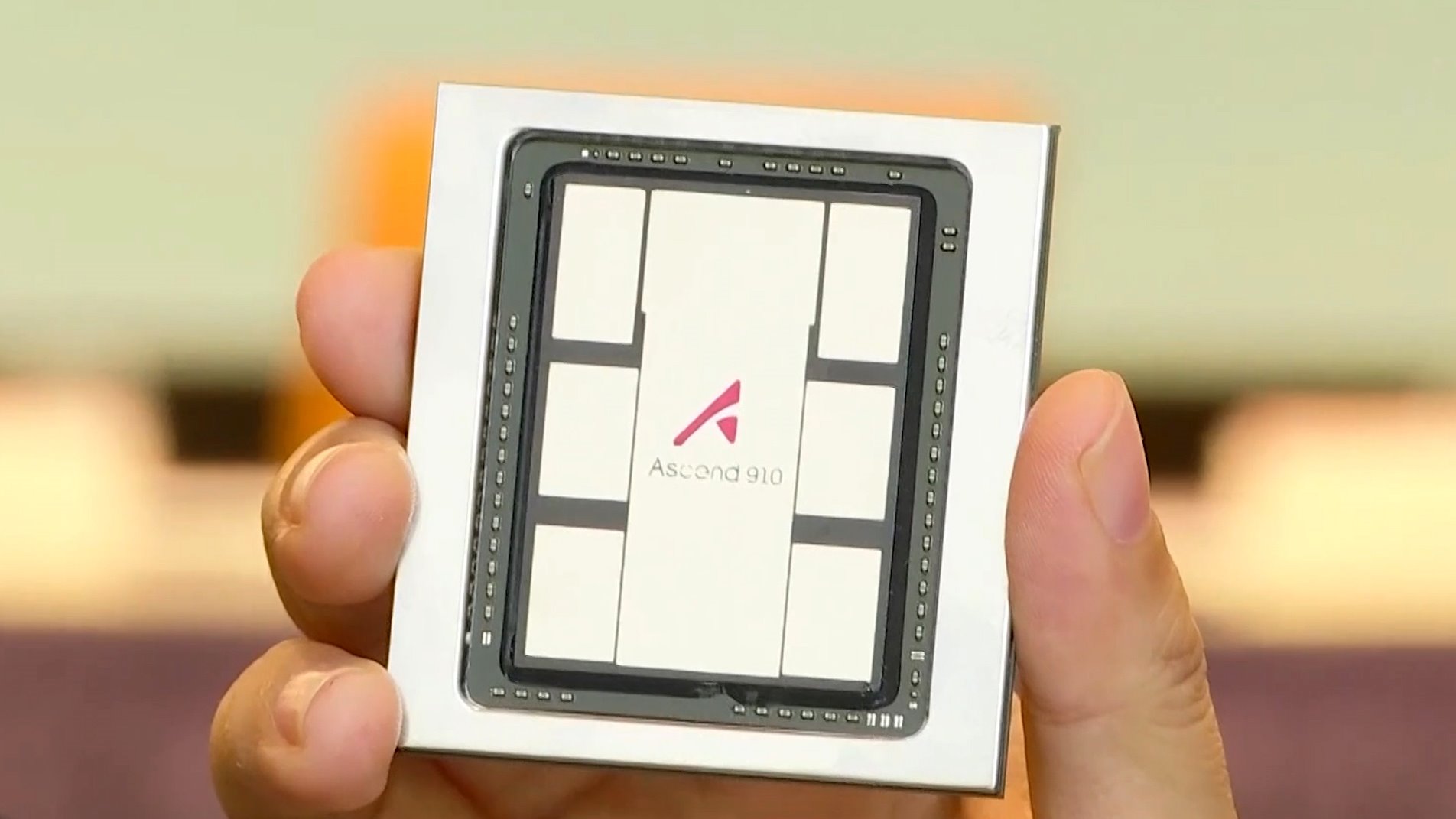

华为昇腾算力成关键筹码

DeepSeek之所以能将价格打到如此之低,与其底层算力路线密切相关。公开信息显示,DeepSeek-V4已成为业内首个在官方文档中完成对华为昇腾NPU认定的万亿参数大模型。昇腾950超节点通过集群方案弥补了国产芯片在单卡制程上的代差,大幅降低了推理成本。

DeepSeek之所以能将价格打到如此之低,与其底层算力路线密切相关。公开信息显示,DeepSeek-V4已成为业内首个在官方文档中完成对华为昇腾NPU认定的万亿参数大模型。昇腾950超节点通过集群方案弥补了国产芯片在单卡制程上的代差,大幅降低了推理成本。

DeepSeek方面更明确表示,当前Pro版服务吞吐受限,预计下半年昇腾950大规模部署后,Pro价格还将“大幅下调”。

这种“国产模型+国产算力”的深度绑定,正在形成一种正向循环:当国内最成熟的开源模型主动适配国产算力生态,开发者和企业客户的粘性将加速向国产硬件迁移。未来大模型竞争的焦点,可能不再是“参数量”,而是“供应链效率”和“算力成本控制能力”。

AI推理从“奢侈品”变为“水电煤”

就在DeepSeek大幅降价的同时,海外部分大模型因算力供应紧张,反而出现了“算力通胀”,API价格有所上涨。一边摊薄一边通胀,两种截然不同的定价路径,折射出不同供应链生态的弹性差异。

摩根大通的预测指出,调用成本的大幅下降并非终点,而是更多企业级应用迅速铺开、更多行业深度整合AI能力的起始点。当顶级模型推理成本被压到每百万Tokens几分钱时,AI将从“稀缺资源”变为“基础设施”。

DeepSeek的此次降价,不仅是一次短期促销,更是其依托国产算力构建长期成本优势的信号弹。大模型的基础能力达到一定程度后,持续降本的能力正成为新的行业核心门槛。谁能在保持性能的同时不断降低使用成本,谁就能跑通通往大众市场的最后一段路。

而对于开发者而言,一个API调用成本几乎可以忽略不计的时代,正在加速到来。