Gemini遭"蒸馏" 谷歌也成受害者?

来源:盖蒂图片社谷歌威胁情报小组披露,Gemini遭遇"蒸馏攻击",单次攻击提示超10万次,攻击者试图通过海量提问克隆模型能力。谷歌首席分析师John Hultquist将公司比作"煤矿里的金丝雀",警告此类攻击将蔓延至中小企业。但谷歌的控诉颇具讽刺意味。2023年,Google高级AI研究员Jacob Devlin警告CEOSundar Pichai,Bard团队可能使用ShareGPT网站的ChatGPT对话数据训练模型,担心这违反OpenAI服务条款。Devlin随后辞

来源:盖蒂图片社

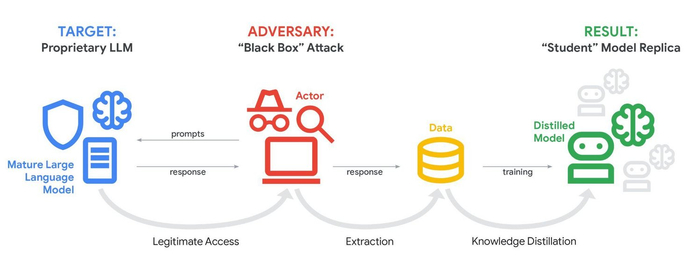

谷歌威胁情报小组披露,Gemini遭遇"蒸馏攻击",单次攻击提示超10万次,攻击者试图通过海量提问克隆模型能力。谷歌首席分析师John Hultquist将公司比作"煤矿里的金丝雀",警告此类攻击将蔓延至中小企业。

但谷歌的控诉颇具讽刺意味。2023年,Google高级AI研究员Jacob Devlin警告CEOSundar Pichai,Bard团队可能使用ShareGPT网站的ChatGPT对话数据训练模型,担心这违反OpenAI服务条款。Devlin随后辞职加入OpenAI。Google发言人明确否认:"Bard没有接受过来自ShareGPT或ChatGPT的任何数据训练。"

"蒸馏攻击"本质是知识产权盗窃——用合法API访问系统性探测成熟模型,提取信息训练新模型,以极低成本复制能力。谷歌强调这违反其服务条款,却对自己从互联网未经许可抓取数据训练模型的行为保持沉默。

攻击源来自全球多地,包括朝鲜、俄罗斯、中国,幕后多为寻求竞争优势的AI私企或研究机构。谷歌拒绝透露具体嫌疑方。

当AI模型成为数十亿美元的核心资产,"蒸馏"与"学习"的边界愈发模糊。谷歌的遭遇或许预示着:在模型能力趋同、输出难辨彼此的今天,知识产权保护将成为AI竞赛的新战场——而规则制定者,往往是那些曾经最擅长打破规则的人。

编辑:Laverne